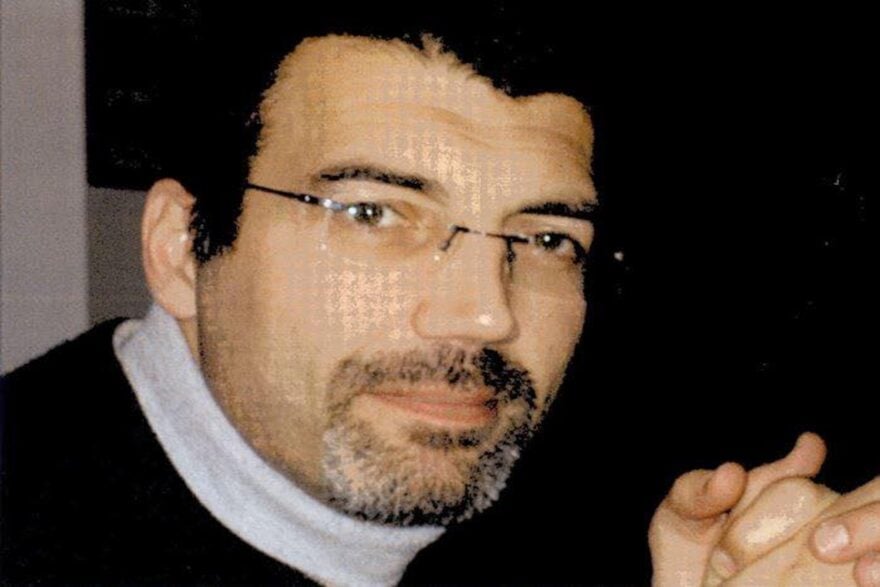

La semaine dernière, Elliot Schrage, un cadre de Facebook responsable de la communication, du marketing et de la politique publique du réseau social, prenait la parole dans une salle pleine de journalistes à Harvard pour évoquer le problème des articles mensongers qui a hanté l’entreprise américaine depuis la victoire de Donald Trump à l’élection américaine.

Peu de temps après l’annonce de la victoire du camp républicain, Facebook a commencé à être pointé du doigt pour ne pas avoir suffisamment agit pour empêcher la prolifération des articles mensongers sur son réseau social, ce qui aurait aidé Donald Trump à devenir président. Buzzfeed avait par exemple découvert que les articles mensongers les plus populaires durant la période de campagne ont obtenu plus d’interactions que ceux des vrais médias comme le New York Times.

Dans un premier lieu, le PDG de Facebook, Mark Zuckeberg, avait démenti la responsabilité de Facebook. Selon lui, 99 % des articles partagés sur Facebook ne sont pas des fake news.

Mais petit à petit, Facebook change de ton. Tout d’abord, après cette élection, il a annoncé quelques mesures pour endiguer les contenus mensongers sur son réseau social, incluant le bannissement des sites de désinformation de ses programmes publicitaires.

Et par ailleurs, lors de son intervention à Harvard, Elliot Schrage a admis l’erreur de Facebook : « Pendant longtemps, nous avons résisté à mettre en place des normes sur l’intérêt médiatique parce que nous ne nous considérions pas comme un service qui est principalement destiné à la distribution de l’information. Et ce fut une erreur. Nous avons une responsabilité. Je pense que nous le reconnaissons. Cela nous a servi de leçon ».

Le cadre de Facebook ajoute qu’avant l’élection présidentielle de 2016 aux Etats-Unis, le réseau social avait pour principal objectif « d’aider les utilisateurs à partager ». Mais celle-ci a obligé le service à « se demander si il a un rôle à jouer dans l’évaluation de la validité de contenu que les gens partagent ».

Le discours d’Elliot Schrage montre également que pour le moment, Facebook ne sait pas encore exactement comment agir. « Je dois vous dire, et c’est l’une des raisons pour lesquelles je suis venu ici, que c’est un rôle effrayant ». En tout cas, bien que quelques médias l’aient suggéré, Facebook n’entend pas recruter une armée d’éditeurs qui seraient chargée d’évaluer les articles afin de vérifier les informations véhiculées. Cela avait déjà été souligné par Mark Zuckerberg qui avait indiqué que Facebook ne veut pas devenir « un arbitre de la vérité ».

Et puis, il est à noter que Facebook avait déjà tenté l’expérience avec une équipe éditoriale, qui était chargée de choisir les sujets à afficher sur sa liste des tendances, aux Etats-Unis. Mais le numéro un des réseaux sociaux a été accusé de partialité politique. Et de ce fait, il a décidé de confier cette section de son site web à des algorithmes, mais plus à des humains.

Rien de concret

Malgré ce mea culpa, Facebook n’a donc proposé rien de concret pour combattre les fake news, outre les mesures qu’il a déjà prises ou celles qui ont récemment été annoncées suite à l’élection de Trump.

Et à l’instar d’un auteur de fake news qui s’était récemment confié au Washington Post, Facebook est convaincu que les utilisateurs sont aussi, du moins en partie, responsables de la propagation des fake news. « Notre activité consiste à donner aux gens le pouvoir de partager, explique-t-il. Et en partie, cela consiste à les aider à partager consciencieusement et de manière responsable, ainsi que de consommer de manière consciencieuse et responsable. Je pense que nous avons besoin d’un programme ‘réfléchissez avant de partager’ pour que les gens ne partagent pas de choses stupides ».

Après, quand on sait que souvent, on partage sur les réseaux sociaux sans même lire l’article, je pense que cette mission sera assez compliquée.

📍 Pour ne manquer aucune actualité de Presse-citron, suivez-nous sur Google Actualités et WhatsApp.