- OpenAI recrute une équipe de chercheurs et d’ingénieurs pour maîtriser l’IA

- Le danger identifié est la « superintelligence », une technologie qui pourrait aider l’humanité à surpasser de nombreux problèmes mais aussi la détruire

- Des dirigeants sont inquiets par les progrès récents de l’intelligence artificielle. Mais des experts tiennent à rassurer

Faut-il mieux encadrer l’intelligence artificielle ? La réponse est oui selon OpenAI, l’éditeur de ChatGPT, et son dirigeant Sam Altman. On aurait pu imaginer que la société qui a beaucoup à gagner avec le développement de cette technologie soit plutôt opposé à la mise en place de règles strictes, mais c’est tout l’inverse.

Après avoir plaidé pour la création d’une agence entièrement dédiée aux modèles de langage aux États-Unis, le CEO lance son entreprise dans une nouvelle mission. En effet, OpenAI vient d’officialiser la création d’une équipe en charge de la supervision de l’IA. Elle sera composée de chercheurs et d’ingénieurs « de haut niveau en apprentissage automatique ».

Une IA pour nous protéger de l’IA ?

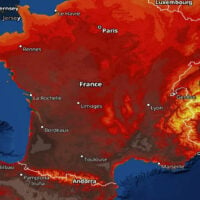

Leur mission? Réfléchir et anticiper les risques liés par l’avènement de la « superintelligence ». Il s’agit d’un progrès possible qui permettrait à l’IA de surpasser l’esprit humain. De quoi donner l’occasion à l’humanité de répondre à d’énormes défis (maladies, changement climatique…), ce qui serait une excellente chose. Mais cette technologie pourrait aussi menacer l’existence même de l’homme, estime la startup.

Face à ce sombre présage, l’équipe va tenter de trouver un moyen de garder l’IA sous contrôle. Si ces modèles de langage sont actuellement supervisés par des humains : ingénieurs et modérateurs, à terme, l’entreprise espère créer une IA capable de surveiller cette « superintelligence ».

OpenAI s’est donc fixé pour objectif de surmonter ces défis techniques d’ici quatre ans. Elle va déployer une feuille de route pour son équipe qui sera prochainement publiée sur son site.

Pour rappel, un sondage a permis d’interroger des dirigeants issus de 119 grandes entreprises telles que Walmart, Coca-Cola, Xerox, Zoom, ainsi que des sociétés issus de l’industrie pharmaceutique et des médias, pour mieux connaître leur point de vue sur cette technologie.

On peut noter que 42 % des répondants pensent que l’IA a le potentiel de détruire l’humanité d’ici 5 à 10 ans, ce qui semble pour le moins pessimiste. De son côté, Yann Le Cun, Chief AI Scientist chez Meta, estime que les ordinateurs ne sont pas près de dépasser l’intelligence humaine. Selon lui, l’idée que l’IA serait une menace pour l’humanité est « ridicule ».

📍 Pour ne manquer aucune actualité de Presse-citron, suivez-nous sur Google Actualités et WhatsApp.