Alors que les géants de l’IA comme Google, OpenAI ou Anthropic sortent des modèles d’intelligence artificielle de plus en plus imposants, la startup française Mistral mise sur une approche différente, qui s’appuie sur des modèles d’IA plus petits, ouverts, que les entreprises peuvent personnaliser pour obtenir les mêmes résultats ou de meilleurs résultats. Mistral, qui est considéré comme le principal acteur européen dans la course à l’intelligence artificielle, vient de présenter sa famille de modèles Mistral 3, tous ouverts.

Des IA personnalisées pour les entreprises

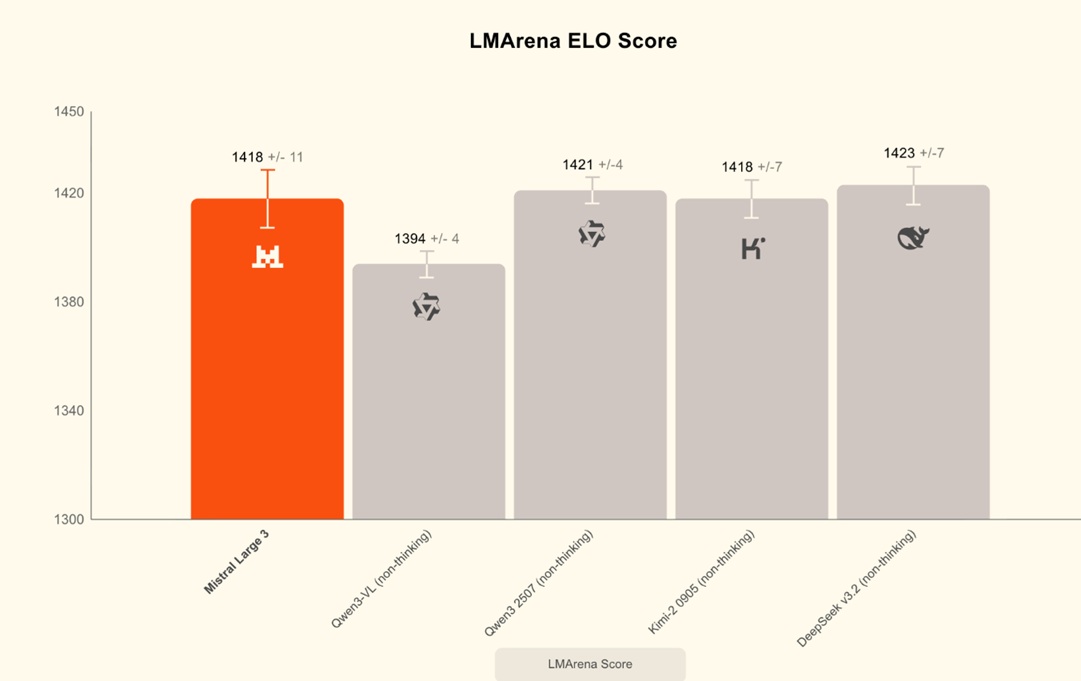

En tout, Mistral vient d’annoncer 10 modèles d’IA différents, dont Mistral 3 Large. Il s’agit d’un modèle dont les performances sont comparables à celles de Deepseek-3.1 ou encore Kimi-K2 d’Alibaba. Et alors que les autres modèles de sa catégorie se focalisent généralement sur la langue de l’entreprise, Mistral 3 Large adopte une approche plus multilingue, afin de rendre les AI ouvertes plus accessibles. Cette nouvelle IA convient à des usages comme l’analyse de documents, le codage, les tâches créatives, et peut aussi servir d’assistant.

Les 9 autres modèles de la famille mistral 3 sont des variantes d’une IA plus petite, baptisée Ministral 3. En substance, la startup française propose des versions avec 3 milliards, 8 milliards et 14 milliards de paramètres. Et, pour chaque taille, Mistral propose une version de base, une version optimisée pour le chat et une version de raisonnement qui est optimisée pour les tâches qui requièrent de la logique. La stratégie de l’entreprise consiste à proposer des modèles ciblés, que les entreprises peuvent aussi personnaliser pour leurs besoins spécifiques.

The world’s best small models—Ministral 3 (14B, 8B, 3B), each released with base, instruct and reasoning versions. pic.twitter.com/AaGDG9tVKf

— Mistral AI (@MistralAI) December 2, 2025

Guillaume Lample, cofondateur et directeur scientifique chez Mistral, explique à TechCrunch que certains clients utilisent d’abord des modèles plus larges et fermés, avant de se rendre compte que ces technologies sont coûteuses et lentes. Ensuite, ils demanderaient à Mistral d’optimiser des modèles plus petits pour leurs besoins spécifiques. Le cofondateur de Mistral affirme par ailleurs que, dans certains cas, un petit modèle peut même surpasser les IA plus grandes.

Des modèles qui peuvent fonctionner localement

Pour séduire les entreprises, l’un des arguments de Mistral est le faible coût d’utilisation de ses petits modèles. “Ministral 3 offre le meilleur rapport coût-performance de tous les modèles OSS”, explique la startup. Ces modèles sont d’ailleurs tellement efficaces qu’ils peuvent fonctionner en local sur un seul GPU allant de 16 Go de VRAM à 4 Go de VRAM avec une quantification de 4 bits.

Il est donc possible, pour une entreprise, d’utiliser une IA capable de fonctionner localement (sans connexion internet et avec une faible latence), qui répond aussi à la plupart de ses besoins. Par ailleurs, ces modèles petits, mais performants peuvent aussi être embarqués sur des produits tels que des drones, des robots autonomes ou des véhicules.

Les nouveaux modèles de Mistral sortent sous licence Apache 2.0 et sont proposés sur différentes plateformes, dont Mistral AI Studio, Amazon Bedrock, Hugging Face, etc.

📍 Pour ne manquer aucune actualité de Presse-citron, suivez-nous sur Google Actualités et WhatsApp.