Qu’elles sortent des serveurs de Google (Veo 3.1) ou d’OpenAI (Sora 2) ces fausses vidéos ont inondé nos flux d’informations, saturant les réseaux sociaux de deepfakes si crédibles qu’ils peuvent tromper un œil même très aguerri. Si les anciens modèles de génération de vidéos par IA souffraient de grosses lacunes et produisaient des rendus étranges et irréalistes il y a encore à peine un an, c’est aujourd’hui de moins en moins le cas.

Heureusement, certaines sont identifiables immédiatement comme étant fausses parce qu’elles sont trop fantaisistes (exemple avec l’image en tête de cet article) ou parce qu’elles comportent encore des artefacts visuels et autres étrangetés qui nous font tiquer. Toutefois, entre les mains de « créateurs » qui savent comment les utiliser à bon escient, elles peuvent brouiller notre esprit au point de ne plus remettre en question la véracité des rendus générés. Pour ne pas sombrer dans la désinformation, il est encore possible de ne plus vous laisser berner… en utilisant l’IA. Oui, le serpent se mord la queue, mais quitte à vivre dans la Matrice, autant demander au concierge de nous en montrer ses coulisses.

SynthID et Gemini : les Sherlock Holmes des fausses vidéos

Google a opéré un revirement spectaculaire avec son modèle Gemini depuis la fin de l’année 2025, marchant dans les plates-bandes d’OpenAI et de ChatGPT, dont la dernière itération a été jugée décevante. Justement, le chatbot de Mountain View est actuellement le meilleur de tous pour déceler la supercherie en un clin d’œil grâce à l’intégration native de SynthID.

C’est une technologie de marquage propriétaire développée par Google DeepMind qui est directement intégrée au processus de génération de ses propres modèles. Par exemple, lorsque vous demandez une vidéo à Veo 3.1 ou une image à Nano Banana, SynthID marquera le contenu au moment même où le modèle la générera.

Il est bien plus efficace que les filigranes rajoutés par-dessus les images, car SynthID intervient sur la composante fréquentielle du signal numérique. Lors de la création de l’image (la phase de débruitage par diffusion), l’algorithme applique des micro-ajustements statistiques sur la distribution des couleurs et de la luminosité.

Des modifications que vos yeux ne peuvent pas percevoir, mais qui signent une vidéo ou une image d’une empreinte indélébile que Gemini est capable de détecter. En téléchargeant l’image ou la capture d’une vidéo sur l’interface du chatbot et en lui posant simplement la question « Cette image a-t-elle été conçue par une IA ? », il scannera les métadonnées et trouvera le marquage SynthID.

C2PA : la riposte face à l’explosion des deepfakes

Toutefois, gardez l’œil ouvert : si SynthID est une arme redoutable pour identifier les contenus maison de Google, il ne peut pas (encore) détecter les vidéos de ses concurrents comme Sora 2. Pour combler ce vide, la firme s’appuie désormais sur un second protocole : la norme C2PA (Coalition for Content Provenance and Authenticity), un historique de traçabilité cryptographique.

C’est une espèce de fiche d’identité numérique qui accompagne le fichier au moment de sa création. Si l’image est prise par un vrai appareil photo (comme les derniers modèles compatibles de chez Leica ou Sony), elle reçoit un certificat d’authenticité. Si elle est générée par l’IA d’Adobe ou d’OpenAI, elle est automatiquement marquée comme générée par un algorithme.

L’énorme avantage de cette norme, c’est son interopérabilité : comme Adobe, Microsoft et OpenAI utilisent aussi ce certificat, vous pouvez savoir si une vidéo ou image a été générée par l’IA d’un concurrent, même si elle ne porte pas le tatouage SynthID de Google.

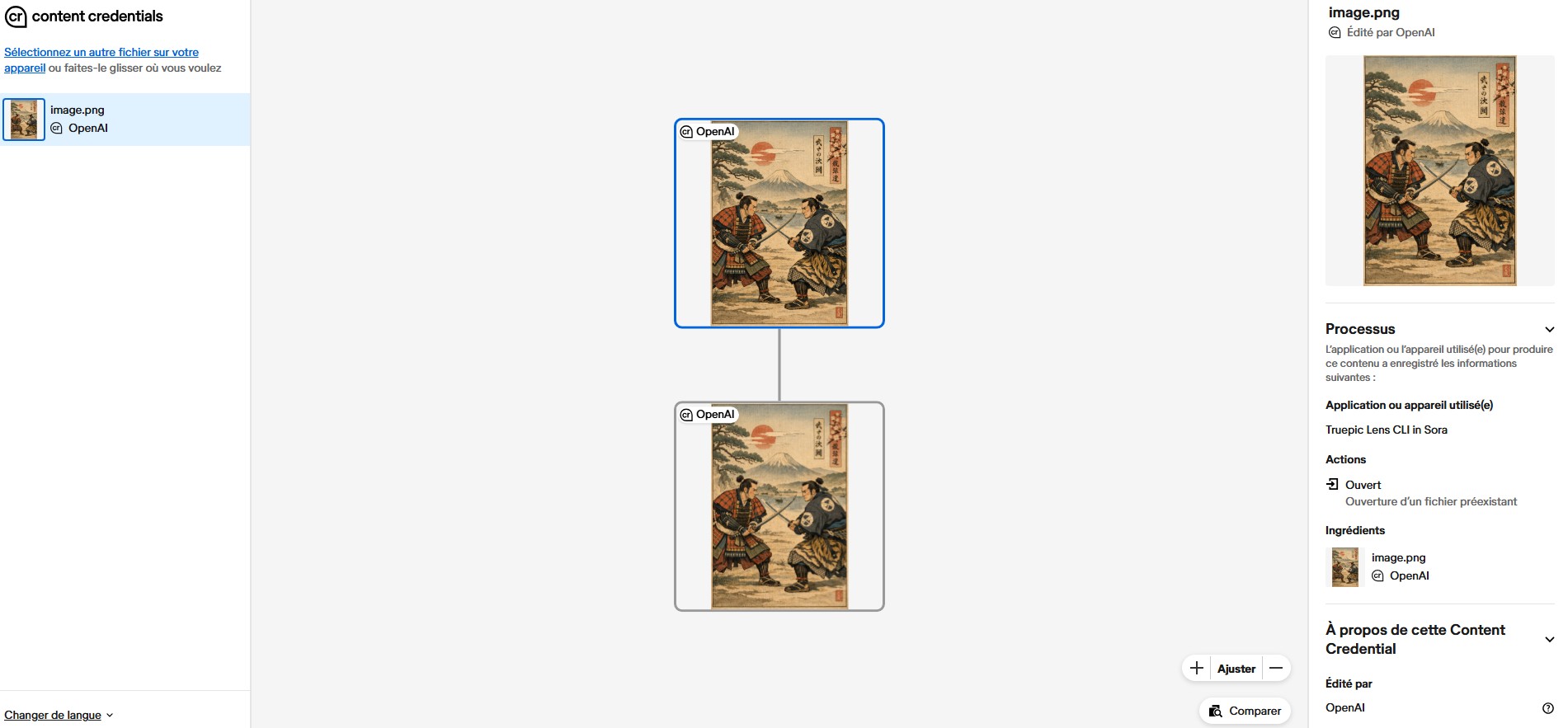

Comment tirer parti de C2PA facilement ? C’est très simple, il suffit de vous rendre sur la plateforme Content Credentials et d’y glisser votre image, le site scanne instantanément le fichier à la recherche de la norme C2PA. Néanmoins, cet outil n’est pas parfait : nous avons essayé avec la capture d’écran qui sert d’en-tête à cet article (provenant d’une vidéo de Sora 2 donc) et il ne l’a pas détectée comme étant générée par IA.

Pourquoi cet échec ? La norme C2PA est un fichier sécurisé qui accompagne l’original, mais il ne survit pas à un screenshot, qui crée techniquement un tout nouveau fichier, vierge de tout passé. C’est son gros talon d’Achille : elle est extrêmement fragile face aux manipulations basiques de l’utilisateur.

En revanche, avec une image générée par ChatGPT (voir ci-dessous) et téléchargée directement depuis son interface en format PNG, Content Credentials la repère en quelques millisecondes.

Aucune technologie, pour le moment, ne remplacera votre esprit critique, si puissante soit-elle. Même si les géants de l’IA tentent de reprendre le contrôle de leurs créations (ce qui est assez ironique, il faut bien l’avouer), nous voilà forcés de demander à un chatbot de nous protéger de lui-même. C’est le comble de l’absurde : utiliser un algorithme pour valider la réalité d’un autre algorithme. « La vérité est si obscurcie en ces temps et le mensonge si établi, qu’à moins d’aimer la vérité, on ne saurait la reconnaître », écrivait Blaise Pascal dans ses Pensées en 1670. Plus de 350 ans plus tard, force est de constater qu’il fut assez visionnaire : nous en sommes réduits à étiqueter le réel pour ne pas le confondre avec la fiction. Restez aux aguets ; dans ce jeu du chat et de la souris, le seul véritable arbitre, c’est vous !

- Les vidéos générées par IA, de plus en plus réalistes, saturent le web et peuvent tromper même les observateurs avisés.

- Google propose des outils comme SynthID et C2PA pour identifier les contenus générés par IA, mais ces solutions ont leurs limites.

- L’esprit critique reste essentiel pour discerner la vérité face à la montée des deepfakes et à la désinformation.

📍 Pour ne manquer aucune actualité de Presse-citron, suivez-nous sur Google Actualités et WhatsApp.